МОСКВА, 14 мар — РИА Новости, Захар Андреев. Появилась вторая после ядерной бомбы технология, которая, с одной стороны, обеспечивает ее владельцам безопасность, а с другой — представляет собой глобальную угрозу. Речь идет об искусственном интеллекте: если его развитие выйдет из-под контроля, все человечество окажется на грани вымирания. Лидеры цифровой индустрии США предложили способ сдерживания, но их идеи вызывают много вопросов.

План Трампа

Сегодня сразу несколько американских корпораций развивают собственную систему искусственного интеллекта. В гонку вооружений — в том числе в вычислительные мощности и необходимую для их работы энергетику — инвестируют огромные средства.

При этом каждая разработка основана на определенной идеологии. Различия в философии иногда принципиальны, однако большинство визионеров сходится в одном: в обозримом будущем появится машинный сверхразум, который превзойдет человека почти во всем.

Это открывает немыслимые перспективы: победа над неизлечимыми болезнями, разрешение глобальных экономических проблем, ответы на все вопросы об устройстве Вселенной. Минус в том, что ИИ, вышедший из-под контроля, или даже неаккуратное обращение с ним может нанести человеческой цивилизации большой урон — а то и вовсе уничтожить ее.

Теперь сообщество "цифровиков" думает над тем, как, с одной стороны, воспользоваться всеми благами технологии, а с другой — не спровоцировать апокалипсис. Поэтому одним из первых указов после возвращения в Белый дом Трамп постановил разработать план действий в области ИИ. В частности, запросил мнение "всех заинтересованных сторон".

"Под угрозой все"

Ответом на этот призыв стал основательный труд под названием "Стратегия суперинтеллекта" за подписью директора Центра безопасности ИИ Дэна Хендрикса, главы Scale AI Александра Вана, а также 69-летнего Эрика Шмидта, под чьим руководством в период с 2001-го по 2017-й компания Google стала главным поисковиком Всемирной паутины.

"Гонка за доминирование с использованием ИИ ставит под угрозу все государства, — констатируют соавторы. — Если в поспешной борьбе за превосходство одна страна непреднамеренно потеряет контроль над своим ИИ, она поставит под угрозу безопасность всех остальных. Есть и другая возможность: если то же государство преуспеет в создании и контроле высокоэффективного ИИ, оно также создаст прямую угрозу выживанию других стран".

Семинар "Мир глазами Google" в рамках ПМЭФ-2011

Чтобы спасти себя, последние вынуждены будут сорвать такой проект любыми способами — от тайных операций вроде хакерских атак до "кинетического поражения" инфраструктуры, обеспечивающей работу нейросетей, говорится в работе. Из этого следует, что развитие ИИ может спровоцировать военный конфликт между крупнейшими державами. Чтобы такого не допустить, Шмидт с коллегами предлагают стратегию, которая будет "опираться на долгую историю политики национальной безопасности".

Разведка, саботаж и бомбы

Они формулируют концепцию MAIM (Mutual Assured AI Malfunction — "Взаимная гарантия неисправности ИИ"). С английского слово maim переводится как "увечье". Это адаптация доктрины времен холодной войны, известной как MAD — mutually assured destruction, "гарантированное взаимное уничтожение" (mad означает "безумный"). Напомним: последняя предполагает, что полномасштабная война между двумя ядерными державами приведет к гибели обеих, следовательно, ни одна из них не решится на первый удар.

Применительно к искусственному интеллекту это означает, что государство не должно создавать свой "Манхэттенский проект" в области ИИ, вместо этого следует развивать средства сдерживания, чтобы не допустить появления машинного сверхразума у стран-конкурентов, пишут Шмидт и его соавторы.

Суперкомпьютер

Они считают, что для этих целей правительства могут использовать:

- разведку;

- скрытый саботаж (вроде израильской программы Stuxnet, направленной против иранской ядерной программы);

- кибератаки, нацеленные на системы охлаждения вычислительных мощностей или ближайшие электростанции;

- кинетические удары по центрам обработки данных;

- атака на активы, не связанные с ИИ.

Все эти акции авторы называют MAIM-атаками.

"Стратегическое состояние MAIM представляет собой потенциально стабильный режим сдерживания, однако необходима осторожность", — отмечается в статье.

ИИ в руках "Бен Ладена"

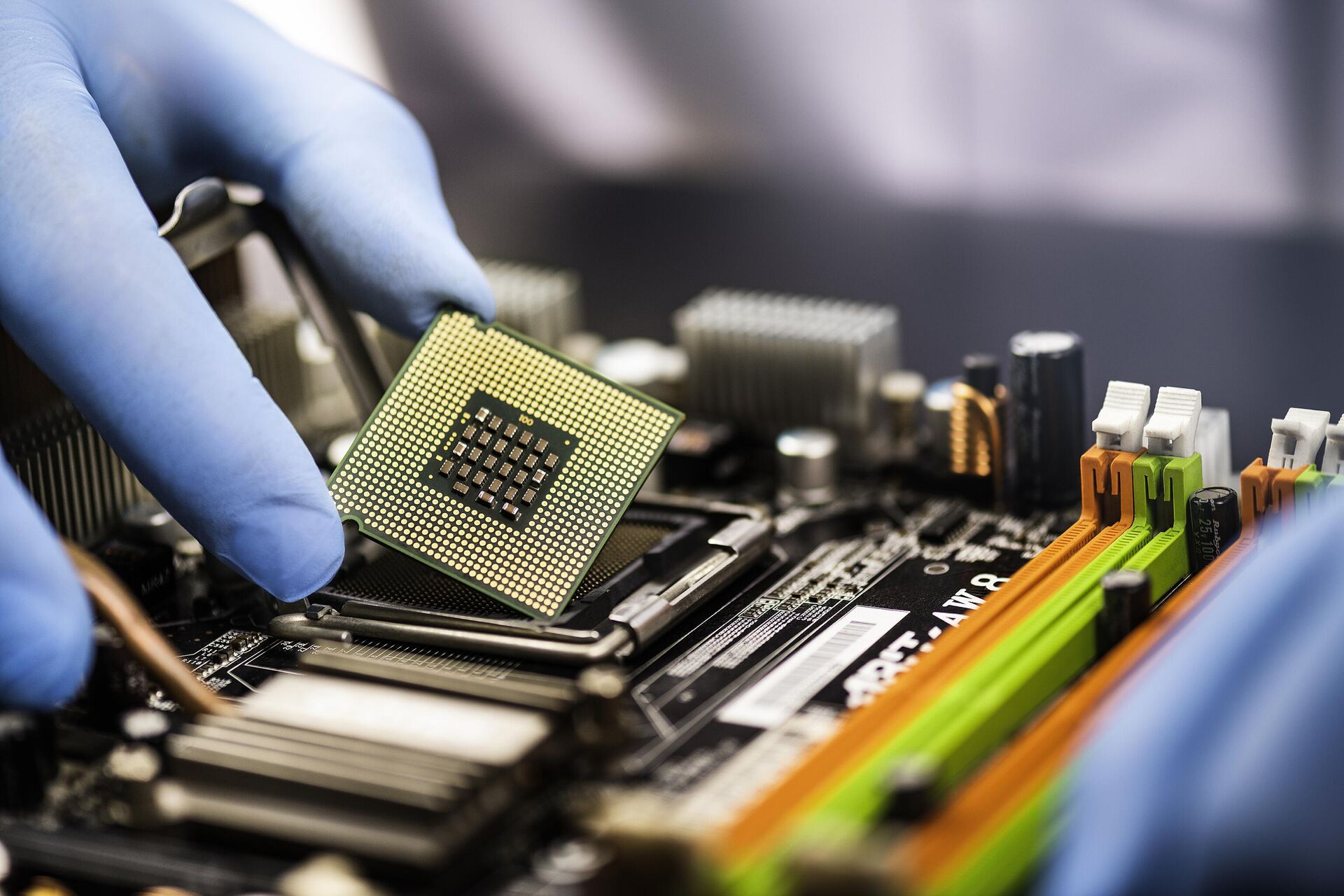

Вторая мера — нераспространение. Шмидт, Хендрикс и Ван предлагают применить к ключевым технологиям ИИ те же ограничения, что и к важнейшим составляющим оружия массового поражения. Например, ввести строгий контроль за перемещением высокопроизводительных чипов. А компаниям — разработчикам ИИ следует принять строгие протоколы безопасности, которые не допускают утечек или выполнения сомнительных заказов. В одном из интервью Шмидт признавался: один из его главных страхов заключается в том, что технологиями ИИ завладеет новый "Бен Ладен".

Производство чипов

В то же время, признают экс-глава Google и его соратники, государства должны сохранять конкурентоспособность в области ИИ — развивать собственное производство технологий, внедрять искусственный разум в оборонные системы, экономику, искать способы решения возникающих при этом социальных проблем.

"Выявляя и сдерживая дестабилизирующие проекты ИИ с помощью разведывательных операций и целенаправленного сбоя, ограничивая доступ злоумышленников к чипам и возможностям ИИ с помощью строгого контроля, гарантируя стабильную цепочку поставок ИИ путем инвестирования в отечественное производство чипов, государства могут обеспечить свою безопасность, одновременно открывая путь к беспрецедентному процветанию", — говорится в статье.

"Так себе сдерживание"

Проблема в том, что призывы авторов во многом расходятся с действиями новой администрации. Трамп уже объявил о создании "нового Манхэттенского проекта" в области ИИ — речь идет о программе Stargate, в которую Вашингтон собирается инвестировать 500 миллиардов долларов.

Примечательно, что Шмидт ранее открыто заявлял о необходимости для США агрессивно конкурировать с Китаем в разработке передовых систем ИИ.

Да и в самой статье содержатся внутренние противоречия. Как отмечает российский политолог Глеб Кузнецов, идея о MAIM-атаках "задает фундаментальное противоречие между декларируемой целью "стабильности технологий" и средствами ее достижения".

"Ракетная атака на стратегически важный объект на территории ядерной державы (а кто еще может конкурировать со Штатами в области ИИ?) — так себе "элемент сдерживания", — пишет он.

По мнению британского обозревателя IT-технологий Дэна Робинсона, Белый дом к словам Шмидта не прислушается.

"США, скорее всего, выберут стратегию невмешательства и позволят своему технологическому сектору делать все, что он захочет, без каких-либо ограничений", — говорит эксперт.

Все что остается, считает он, — утешать себя тем, что до появления любого "суперинтеллекта" еще далеко. Но это не точно.

Комментариев нет:

Отправить комментарий