Автор: Хоаким Коуто, Институт Браунстоуна.

Было время, когда дебаты о детерминизме и свободе воли были прерогативой философских факультетов и ночных разговоров в студенческих общежитиях.

Они доставляли удовольствие именно потому, что казались безобидными. Каким бы ни был ответ, жизнь продолжалась. Суды выносили решения, врачи принимали решения, учителя учили, а политики по-прежнему — по крайней мере, номинально — несли ответственность за свои действия.

Эта эпоха закончилась.

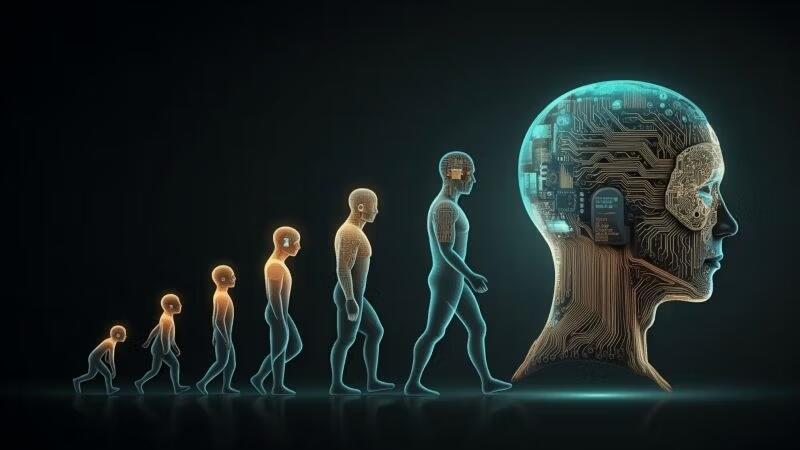

Искусственный интеллект превратил некогда казавшийся абстрактным философским вопросом в конкретную проблему управления, власти и подотчетности. Детерминизм перестал быть просто теорией о том, как устроен мир. Он становится принципом функционирования современных институтов. И это меняет всё.

Системы искусственного интеллекта по своей природе детерминированы. Они работают на основе статистического вывода, оптимизации и вероятности. Даже когда их результаты нас удивляют, они остаются связанными математическими ограничениями. Ничто в этих системах не напоминает суждение, интерпретацию или понимание в человеческом понимании.

Искусственный интеллект не принимает решений.

Это не отражает реальность.

Оно не несёт ответственности за результаты.

Однако все чаще результаты этой работы рассматриваются не как инструменты, а как решения. Это тихая революция нашего времени.

Привлекательность очевидна. Учреждения всегда сталкивались с проблемой изменчивости человеческого поведения. Люди непоследовательны, эмоциональны, медлительны и порой непослушны. Бюрократические структуры предпочитают предсказуемость, и алгоритмы обещают именно это: стандартизированные решения в больших масштабах, невосприимчивые к усталости и несогласию.

В здравоохранении алгоритмы обещают более эффективную сортировку пациентов. В финансах — более качественную оценку рисков. В образовании — объективную оценку. В государственной политике — «доказательное» управление. В модерации контента — нейтральность. Кто может возражать против систем, которые, как утверждается, устраняют предвзятость и оптимизируют результаты? Но за этими обещаниями скрывается фундаментальная путаница.

Предсказание — это не суждение.

Оптимизация — это не мудрость.

Последовательность не является легитимностью.

Принятие решений человеком никогда не было чисто вычислительным процессом. По своей природе оно носит интерпретативный характер. Люди взвешивают контекст, смысл, последствия и моральную интуицию. Они опираются на память, опыт и чувство — пусть и несовершенное — ответственности за последующие действия. Именно это и вызывает неудобства у институтов.

Человеческое суждение порождает трения. Оно требует объяснений. Оно делает лиц, принимающих решения, уязвимыми для обвинений. Детерминированные системы, напротив, предлагают нечто гораздо более привлекательное: принятие решений без участия лиц, принимающих решения.

Когда алгоритм отказывает в кредите, помечает гражданина как нарушителя, снижает приоритет пациента или подавляет свободу слова, никто не кажется ответственным. Это сделала система. Данные сказали. Модель приняла решение.

Детерминизм превращается в бюрократическое алиби.

Технологии всегда формировали институты, но до недавнего времени они в основном расширяли возможности человека. Калькуляторы помогали в рассуждениях. Электронные таблицы проясняли компромиссы. Даже ранние программы оставляли за человеком явный контроль. Искусственный интеллект меняет эти отношения.

Системы, предназначенные для прогнозирования, теперь призваны принимать решения. Вероятности превращаются в политические решения. Оценки рисков становятся вердиктами. Рекомендации незаметно превращаются в предписания. Однажды внедренные в систему, эти системы трудно оспорить. В конце концов, кто будет спорить с «научными данными»?

Вот почему старая философская дискуссия стала столь актуальной.

Классический детерминизм основывался на утверждении о причинно-следственной связи: при наличии достаточной информации будущее можно предсказать. Сегодня детерминизм превращается в философию управления. Если результаты можно предсказать достаточно точно, спрашивают институты, зачем вообще допускать свободу действий?

Недетерминизм часто карикатурно изображают как хаос. Но в правильном понимании это не случайность и не иррациональность. Это пространство, где происходит интерпретация, где взвешиваются ценности и где ответственность лежит на человеке, а не на процессе.

Уберите это пространство, и процесс принятия решений не станет более рациональным. Он станет безответственным.

Реальная опасность ИИ заключается не в вышедшем из-под контроля интеллекте или разумных машинах. Она состоит в медленном разрушении человеческой ответственности под знаменем эффективности.

Главный конфликт XXI века будет не между людьми и машинами. Он будет между двумя представлениями об интеллекте: детерминированной оптимизацией и осмыслением в условиях неопределенности .

Один из них масштабируем.

Ответственность несёт другой.

Искусственный интеллект заставляет нас решать, какой из них будет управлять нашей жизнью.

Комментариев нет:

Отправить комментарий