Автор Мартин Янг через CoinTelegraph.com,

По словам исследователей Apple, гонке за разработку общего искусственного интеллекта (AGI) еще предстоит пройти долгий путь, и они обнаружили, что ведущим моделям ИИ по-прежнему трудно рассуждать.

Последние обновления ведущих больших языковых моделей искусственного интеллекта (LLM), таких как ChatGPT от OpenAI и Клод из Anthropic включили большие модели рассуждений (LRM), но их фундаментальные возможности, свойства масштабирования и ограничения “остаются недостаточно изученными”, заявили исследователи Apple в июне бумага называется “Иллюзия мышления.”

Они отметили, что текущие оценки в первую очередь сосредоточены на установленных математических и кодирующих критериях “с упором на точность окончательного ответа”

Однако, по их словам, эта оценка не дает представления о возможностях рассуждения моделей ИИ.

Исследование контрастирует с ожидание что общий искусственный интеллект появится всего через несколько лет.

Исследователи Apple тестируют “думают” модели ИИ

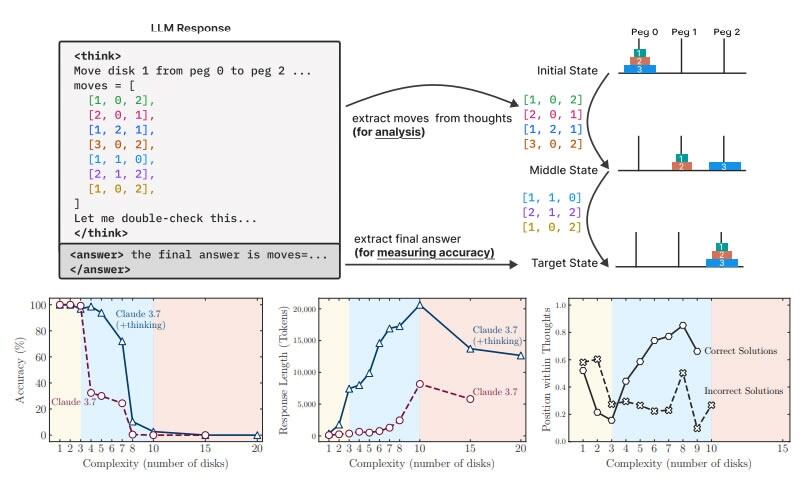

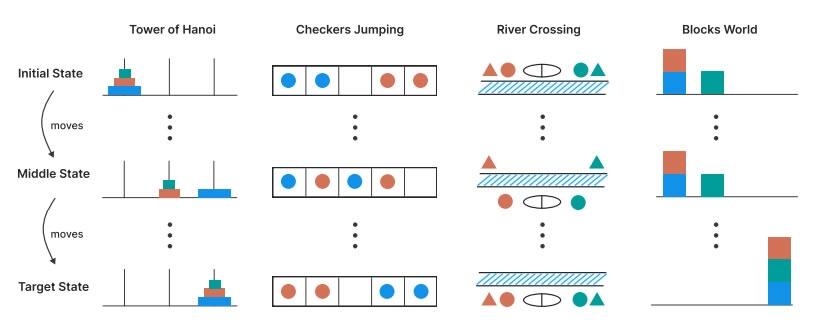

Исследователи разработали различные игры-головоломки для тестирования “думающих” и “недумающих” вариантов Claude Sonnet, o3-mini и o1 от OpenAI, а также чат-ботов DeepSeek-R1 и V3, выходящих за рамки стандартных математических тестов.

Они обнаружили, что “пограничные LRM сталкиваются с полным падением точности за пределами определенных сложностей” не обобщают рассуждения эффективно, и их преимущество исчезает с ростом сложности, вопреки ожиданиям относительно возможностей AGI.

“Мы обнаружили, что LRM имеют ограничения в точных вычислениях: они не используют явные алгоритмы и рассуждают непоследовательно в разных головоломках.”

Проверка окончательных ответов и промежуточных трассировок рассуждений (верхняя диаграмма), а также диаграммы, показывающие немыслящие модели, более точны при низкой сложности (нижние диаграммы). Источник: Исследования машинного обучения Apple

Исследователи утверждают, что чат-боты на основе искусственного интеллекта слишком много думают

Они обнаружили непоследовательные и поверхностные рассуждения с моделями, а также наблюдали чрезмерное мышление: чат-боты с искусственным интеллектом рано генерировали правильные ответы, а затем переходили к неправильным рассуждениям.

Исследователи пришли к выводу, что LRM имитируют модели рассуждений, не интернализируя и не обобщая их по-настоящему, что не соответствует рассуждениям на уровне AGI.

“Эти идеи бросают вызов преобладающим предположениям о возможностях LRM и предполагают, что современные подходы могут сталкиваться с фундаментальными препятствиями на пути обобщаемых рассуждений.”

Иллюстрация четырех сред головоломки. Источник: Apple

Гонка за разработку AGI

AGI — это Святой Грааль Разработка ИИ, состояние, при котором машина может думать и рассуждать как человек и находится на одном уровне с человеческим интеллектом.

В январе генеральный директор OpenAI Сэм Альтман сказал фирма была ближе к созданию AGI, чем когда-либо прежде. “Теперь мы уверены, что знаем, как создавать AGI в том виде, в каком мы его традиционно понимали”, - сказал он тогда.

В ноябре генеральный директор Anthropic Дарио Амодей сказал что AGI превысит человеческие возможности в ближайшие год-два. “Если вы просто посмотрите на темпы роста этих возможностей, вы подумаете, что мы достигнем этого к 2026 или 2027 году”, - сказал он.

Комментариев нет:

Отправить комментарий